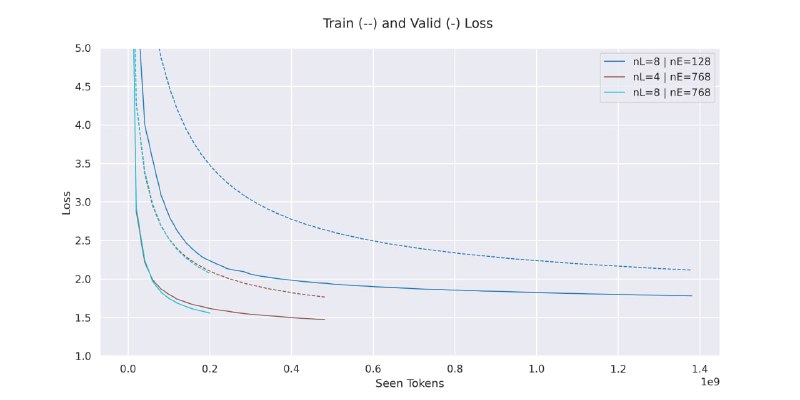

کامل نیست، ولی اثر سایز مدل رو ببینید؛

دو تا فاکتور تعداد لایه (nL) و هیدن سایز (nE) رو تغییر دادم و سه تا مدل بدست اومد.

مدل آبی حدودا 3 میلیون پارامتر داره. خیلی کوچیکه. با اینکه خیلی بیشتر از دو مدل دیگه آموزش دیده (حدود 1.4 بیلیون توکن)، اما اختلاف زیادی باهاشون داره.

دو مدل دیگه بههم نزدیک هستن. فرقشون در تعداد لایههاست. یکی 4 لایه و دیگری 8 لایه. مشخص هست که مدل 8 لایه عملکرد بهتری داره. مدل 4 لایه به 400 میلیون توکن نیاز داشته تا به لاس زیر 1.5 برسه. اما به نظر میرسه که مدل 8 لایه با تعداد توکنهای کمتری میتونه این رکورد رو بزنه.

خوبه که یک نمونه جنریشن با پرامپت مشابه از دو مدل آبی و قهوهای ببینیم. اون مدل فیروزهای که هیچ، به اندازه کافی ترین نشده...

>>Click here to continue<<